AI nie rozumie prawdy w sensie filozoficznym, a jedynie statystycznie ocenia prawdopodobieństwo, że dana informacja jest prawdziwa na podstawie ogromnych zbiorów danych.

Modele językowe nie sprawdzają źródeł w czasie rzeczywistym ani nie prowadzą własnego dochodzenia. Analizują wzorce – spójność, powtarzalność, reputację źródła i zgodność z innymi wiarygodnymi encjami.

Twoim zadaniem jest więc udowodnić sztucznej inteligencji, że przekazywane przez Ciebie informacje są prawdziwe i wartościowe dla użytkowników – w sposób, który będzie dla niej zrozumiały.

Kryteria wiarygodności w oczach AI

1. Entity Identity, czyli mapa cyfrowych powiązań

Dla modeli językowych Twoja marka nie jest tylko adresem URL – to encja (entity), którą AI próbuje umiejscowić w swoim grafie wiedzy.

Jeśli system nie potrafi jednoznacznie odpowiedzieć na pytania o to, czym/kim jest dana marka, domena czy osoba, w jakim obszarze tematycznym funkcjonuje, z jakimi rozpoznawalnymi encjami jest powiązana i czy pojawia się w innych wiarygodnych źródłach, prawdopodobieństwo jej cytowania wyraźnie maleje.

I od razu mówię, że bio autora pod artykułem nie wystarczy. Musisz stać się dla AI obiektem (encją), który jest łatwo weryfikowalny w zewnętrznych bazach.

Co buduje silną tożsamość?

- Poprawnie wdrożone dane strukturalne Organization i Person – schema.org z właściwościami name, url czy logo pozwala systemom jednoznacznie zidentyfikować, kim jesteś i z jakimi encjami jesteś powiązany.

- Właściwość sameAs łącząca domenę z oficjalnymi profilami – odnośniki do LinkedIn, Wikipedia, Crunchbase, Google Business Profile i innych weryfikowalnych źródeł sygnalizują, że marka funkcjonuje w szerszym ekosystemie informacji, a nie wyłącznie w obrębie własnej strony.

- Spójność nazwy, opisu i identyfikacji wizualnej w całym Internecie – identyczne brzmienie nazwy, brak sprzecznych wersji, konsekwentne używanie tych samych określeń wzmacnia tzw. entity confidence i zmniejsza ryzyko błędnego przypisania danych.

- Profile autorów z realnym doświadczeniem i cyfrowym śladem – publikacje, cytowania, obecność w mediach, wystąpienia branżowe czy aktywność ekspercka budują kontekst, który pozwala modelowi przypisać informacje do konkretnej, rozpoznawalnej osoby czy marki.

2. Architektura dowodów

AI ufa wzorcom, które może potwierdzić. Każde twierdzenie w Twoim artykule jest dla modelu hipotezą, którą musi osadzić w szerszym kontekście.

Jeśli dajesz modelowi możliwość łatwego wskazania źródła, zdejmujesz z niego odpowiedzialność za ryzyko potencjalnych halucynacji – a to sprawia, że stajesz się bezpiecznym wyborem do zacytowania.

O jakie aspekty warto zatem zadbać?

- Precyzja w podawaniu źródeł – zamiast pisać ogólnikowo „badania pokazują”, używaj konkretów: „Według raportu Gartnera z Q4 2025…”. To pozwala modelowi na błyskawiczny cross-referencing, czyli potwierdzenie Twoich słów w swojej bazie wiedzy.

- Sekcje z listą źródeł i metodologią – jawne podawanie źródeł danych pod artykułem lub w specjalnych modułach to dla crawlerów sygnał rzetelności. AI widzi, że Twoja treść nie powstała w próżni, a jest syntezą sprawdzalnych faktów.

- Cytowanie źródeł pierwotnych – raporty, badania, dane instytucji publicznych i dokumenty regulacyjne są dla AI znacznie silniejszym sygnałem niż parafraza artykułu z bloga.

- Oddzielenie faktów od opinii – jasne komunikowanie, co jest analizą, a co twardymi danymi, zmniejsza niejednoznaczność interpretacyjną.

- Transparentność ograniczeń – wskazanie, kiedy dane są przybliżone lub zależne od kontekstu, zwiększa wiarygodność Twoich treści, zamiast ją osłabiać.

- Unikalne dane własne (Information Gain) – publikowanie własnych statystyk, case studies i liczb wyciągniętych prosto z Twojego biznesu sprawia, że stajesz się pierwotnym źródłem informacji.

3. Struktura zoptymalizowana pod chunking

Modele językowe nie analizują artykułu jako całości – tną go na mniejsze fragmenty, czyli tzw. chunki, a następnie zamieniają je na wektory matematyczne. Jeśli tworzysz przydługie wstępy czy stosujesz dygresje, które rozmywają treści, AI nie będzie potrafiło wyciąć z nich konkretnej odpowiedzi.

O co zadbać w strukturze tekstów?

- Samowystarczalne akapity – każdy blok tekstu pod nagłówkiem H2 lub H3 powinien stanowić zamkniętą jednostkę wiedzy. Jeśli AI wyciągnie ten fragment z kontekstu, musi on nadal nieść pełną i zrozumiałą odpowiedź dla użytkownika.

- Gęstość encji zamiast słów kluczowych – algorytmy sprawdzają, czy w tekście naturalnie występują pojęcia powiązane z daną tematyką (encje). Jeśli piszesz o specjalistycznym temacie, używaj fachowej terminologii.

- Hierarchia HTML – poprawne stosowanie nagłówków to dla AI drogowskaz, który ułatwia mu wyciąganie najważniejszych informacji z Twoich treści.

- Unikanie odniesień wstecznych – sformułowania typu „jak wspomniałem wcześniej” utrudniają wektorowe przetwarzanie tekstu. Lepiej powtórzyć podmiot, by dany fragment był w pełni zrozumiały dla algorytmów jako samodzielny chunk.

👉 Dowiedz się więcej na temat chunkingu.

4. Reputacja zewnętrzna i walidacja społeczna

AI buduje reprezentację encji nie tylko na podstawie Twojej strony, ale całego ekosystemu informacji, w którym funkcjonuje Twoja marka/osoba.

Zwracaj więc uwagę na następujące czynniki:

- Wzmianki w mediach i portalach branżowych – AI analizuje tzw. unlinked mentions. Nawet jeśli duży portal o Tobie napisze, ale nie poda linku, dla modeli LLM jest to jasny sygnał, że Twoja marka czy osoba jest rozpoznawalna w danej branży.

- Aktywność w zaufanych społecznościach (Reddit, fora branżowe) – w ostatnich latach Google i modele AI zaczęły premiować dyskusje prawdziwych ludzi. Jeśli Twoje rozwiązania lub artykuły są przywoływane w wątkach na Reddicie czy Quorze, AI traktuje to jako silny dowód społeczny.

- Obecność w zestawieniach i rankingach typu TOP 10 – modele często budują swoje odpowiedzi, kompilując dane z wielu list i rankingów. Regularna obecność Twojej marki w zewnętrznych zestawieniach utrwala w modelu statystyczne przekonanie, że jesteś liderem w danej kategorii.

- Profil linków zwrotnych – choć klasyczne SEO mówi o linkach pod kątem mocy, dla AI link z domeny .gov, .edu czy uznanego medium jest przede wszystkim dowodem rzetelności.

- Opinie i sentyment użytkowników – AI potrafi ocenić ogólny wydźwięk opinii o Twojej marce w sieci. Jeśli przeważają negatywne wzmianki lub kontrowersje, systemy mogą celowo pomijać Twoje treści w odpowiedziach doradczych, by nie narażać użytkownika na kontakt z marką o złej reputacji.

5. Techniczne sygnały bezpieczeństwa

AI zwraca uwagę przede wszystkim na:

- Certyfikat SSL i bezpieczeństwo danych – to dziś absolutne minimum. Brak szyfrowania to dla AI sygnał wysokiego ryzyka. Systemy bezpieczeństwa (Safety Filters) w modelach LLM są zaprogramowane tak, by w odpowiedziach generatywnych omijać witryny, które nie gwarantują bezpiecznego połączenia.

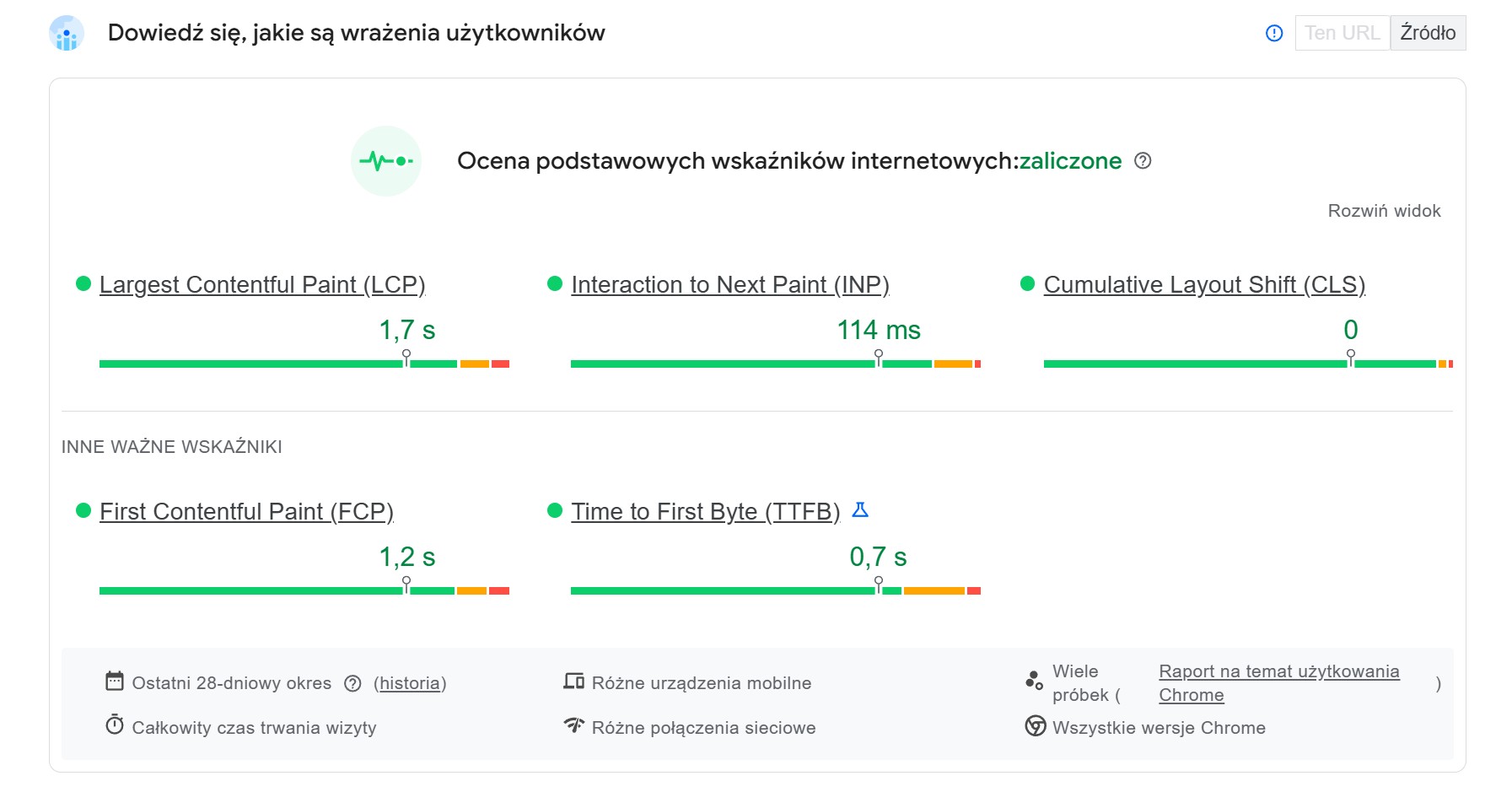

- Core Web Vitals – płynność działania witryny jest dla maszyn pośrednim dowodem na to, że za treścią stoi profesjonalna organizacja.

- Dostępność (Accessibility) – poprawne opisy ALT pod grafikami, kontrasty i hierarchia nagłówków ułatwiają algorytmom zrozumienie zawartości strony.

- Brak agresywnych formatów reklamowych – nadmiar pop-upów, reklam zasłaniających treść czy automatycznie odtwarzanych wideo nigdy nie jest dobrym pomysłem.

6. Świeżość i aktualizacja danych

Regularne odświeżanie treści to dla algorytmu sygnał, że autor dba o rzetelność i nie serwuje użytkownikom przeterminowanej wiedzy.

Na co zwracać uwagę, aktualizując treści?

- Widoczna data ostatniej aktualizacji tekstu – używanie znacznika lastUpdated w danych strukturalnych i czytelna informacja o dacie odświeżenia tekstu to najprostszy sposób na podbicie autorytetu artykułu w oczach modeli LLM.

- Usuwanie nieaktualnych wzmianek i linków – jeśli piszesz o „nadchodzących trendach na 2024 rok”, a mamy rok 2026, model automatycznie obniża wskaźnik zaufania.

- Uzupełnianie treści o bieżący kontekst – dodanie krótkiego akapitu o tym, jak opisywane zjawisko wygląda w dzisiejszych realiach, zmienia postrzeganie tekstu przez roboty wyszukiwarek AI.

- Monitorowanie luk w wiedzy modeli – AI często opiera się na danych treningowych, które mogą nie uwzględniać nowości. Jeśli Twoja treść wypełnia te luki najnowszymi informacjami, stajesz się dla systemu źródłem aktualnej wiedzy.

Sygnały, które obniżają wiarygodność w oczach AI

Czego unikać, by nie stracić zaufania algorytmów?

- Błędy logiczne, niespójności merytoryczne między artykułami lub w ich obrębie – sprzeczne dane, różne definicje tych samych pojęć, brak aktualizacji przy zmieniających się regulacjach podnoszą wskaźnik ryzyka.

- Sprzeczność z ogólnie przyjętym konsensusem – jeśli Twoje treści głoszą tezy drastycznie odbiegające od faktów utrwalonych w pamięci modelu, AI raczej nie uzna ich za wiarygodne. Odważne tezy wymagają w 2026 roku wielokrotnie silniejszego podparcia źródłami niż kiedykolwiek wcześniej.

- Generyczność i brak Information Gain – AI potrafi matematycznie ocenić, czy Twój tekst wnosi coś nowego, czy jest tylko kolejną parafrazą istniejących już w sieci artykułów. Treści, które nie dostarczają unikalnych danych, opinii czy wniosków, są klasyfikowane jako thin content i ignorowane przez asystentów.

- Brak autorytetu w tematach YMYL – w kategoriach takich jak zdrowie, finanse czy prawo, brak wskazania konkretnego eksperta (autora) lub brak linków do oficjalnych dokumentów jest dla AI sygnałem wysokiego ryzyka. W takich papierów na bycie autorytetem.

- Clickbaity i emocjonalny język – nadużywanie wykrzykników, przymiotników typu szokujący czy niewiarygodny budzi podejrzenia algorytmów. Odpuść też klasyczne clickbaity.

Podsumowanie

Jeśli chcesz, aby Twoje treści były cytowane w odpowiedziach generatywnych, musisz myśleć jak system AI i:

- budować jednoznaczną tożsamość encji,

- dostarczać sprawdzalne źródła,

- publikować unikalne dane

- i tworzyć strukturę, którą model może łatwo pociąć na samowystarczalne fragmenty wiedzy.

To wszystko znajduje odzwierciedlenie w danych.

Szczególnie ciekawe jest niedawno opublikowane badanie Authority Signals in AI Cited Health Sources: A Framework for Evaluating Source Credibility in ChatGPT Responses, które potwierdza, że przynajmniej w obszarze zdrowia AI opiera swoje odpowiedzi aż w 75% na uznanych encjach o silnej tożsamości cyfrowej (jak Mayo Clinic czy NHS), ignorując źródła bez wyraźnych powiązań instytucjonalnych. Oznacza to, że dla modelu nie liczy się wyłącznie sama treść, ale Twoja weryfikowalna obecność w całym ekosystemie danych.

Wiesz zatem, do czego dążyć. Powodzenia!

Katarzyna Kwartnik

Katarzyna Kwartnik